イベント

PS VR用「X-wing VR Mission」の秘密やUE4ベースの映像制作システムに注目が集まった,SIGGRAPH 2017「Real-Time Live!」

|

SIGGRAPH 2010で初めて行われたシアターでのイベントなのだが,上映するのはプリレンダリングされたムービーではなく,すべてリアルタイムかつインタラクティブな映像だ。その内容は多岐にわたり,科学技術系のシミュレーションからゲームのプレイまで,実にさまざまなものがあって面白い。

SIGGRAPHのシアター系イベントの中では,唯一撮影が許可されている催し物であること,一部の上映作は参加者のPCでも試せることなどにより,今や定番の人気イベントと言えよう。

|

|

残念ながら,今年のRTLに日本勢の出品はなかったが,さまざまなRTL出展作の中から,4Gamer読者の関心が高そうなグラフィックス関連の作品を簡単に紹介しよう。

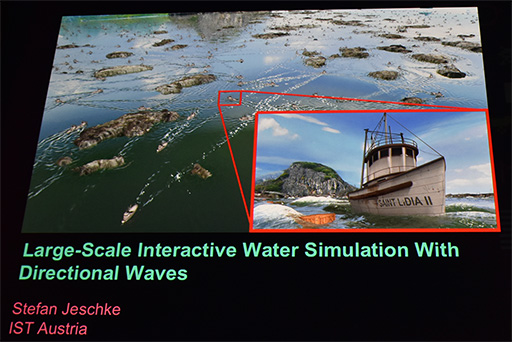

広大な水面の動きを表現する新手法が登場

Institute of Science and Technology Austria(IST Austria)とNVIDIAによる共同研究グループは,水面の表現をテーマにしたデモ「Large-scale Interactive Water Simulation With Directional Waves」を披露した。これは,共同研究グループによる論文「Water Wave Packets」をもとに,同チームが実装したデモソフトウェアによるものだ。

|

水面の表現は,ゲームグラフィックスにとって長年ホットであり続けてきたテーマである。

水面の表現というものは,どこまでミクロに,あるいはマクロに表現するかによって,適用するシミュレーションの手法が変わってくるのがポイントだ。たとえば,水をコップに注いだり,風呂桶や水槽の水をかき混ぜたりして水塊が動く表現ならば,流体シミュレーション系のアプローチが適する。一方,池や湖,川や海のように広い水面に対しては,波動シミュレーションを適用するのが一般的といった具合だ。

共同研究グループによるWater Wave Packetsは,どちらかといえば後者の表現用のテクニックになる。論文の詳細は,こちらのリンク先を参照してもらうとして,ここではデモの説明を続けよう。

Water Wave Packetsの概念は,ちょうど10年前のSIGGRAPH 2007で,Texas A&M UniversityのCem Yuksel氏らが発表した「Wave Particle」のアイデアを拡張したものといえる。Wave Particle自体は,実際のゲームでもよく使われている手法で,たとえば日本でも「ロスト プラネット 2」が採用したことが,CEDEC 2010のセッションで明らかにされたことがある。

|

ここで,水面上を走るボートの後ろに水を掻き分けるような頂点アニメーションのWave Particleを付けると,ボートが波をかき分けて走っているように見えるはずだ。つまりWave Particleは,物理的に正しいシミュレーションというよりも,疑似物理とも言えるプロシージャルアニメーションの手法に近いものだった。

一方,Water Wave Packetsでは,Wave Particle自体を動かしたり,拡大縮小したりできるし,シミュレーション結果に基づいて波の形状を変形させることも可能だ。

たとえば,波が障害物に当たれば反射波が発生するし,障害物に対して回り込むような回折波が生じることもあるだろう。そうした現象をそれぞれのWave Particleに反映しながら,Wave Particle全体を動作させる。これにより,Wave Particleによる波表現が,よりリアルなシミュレーションベースの表現に近づくというわけだ。

RTLでの実演では,浅瀬では波の高さが低くなる一方で,波の速度は速くなる様子や,水辺で波の反射が起きる様子を披露した。また,水面に大量の箱を投げ込んだり,たくさんの船を走らせたりして,リアルな波の動きを再現できるというデモも実演された。

波の表現がリアルに見えるゲームでも,岸辺に反射する波の表現までも行っているものは,今のところほとんどない。Water Wave Packetsでは,そういった表現が可能になるという点に感動した。

応用範囲の広そうな技術だけに,今後はゲームグラフィックスでの採用も進んでいくと期待できる。

PS VR用「X-wing VR Mission」は,リアルタイムに解像度を切り替える

|

セッションを担当したのは,本DLCの開発を担当したCriterion GamesのエンジニアであるAngel Munoz Berbel氏。余談だが,Criterion Gamesは,BurnoutシリーズやNeed For Speedシリーズの開発元としても知られている。

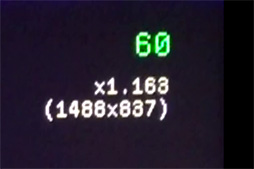

セッションの冒頭で語られたのは,動的な可変解像度レンダリングテクニックについてだ。

SWBFのゲームエンジンは,Electronic Arts作品で汎用的に使われている「Frostbite」を用いており,ゲーム中のフレームレートは60fpsになるよう設計されているそうだ。一方,X-wing VR MissionはVRゲームなので,プレイヤーの頭の動きに対する遅延を減らすために,映像のフレームレートを120fpsに上げているという。

この60fpsから120fpsへとフレームレートを上げるプロセスに,VRコンテンツでは定番のTime Warp(タイムワープ,PS VRではTime Reprojectionと呼ぶ)処理を使うことで,映像表示が間に合わないときに,頭の動きに合わせて既存のフレームを動かす手法を取り入れていることは,言うまでもないだろう。

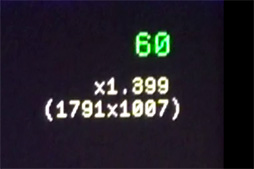

そんなX-wing VR Missionのレンダリングテクニックとして興味深いのは,ゲーム中の映像を,基準となる解像度より最大で1.4倍ほど高い解像度で描画しているというところだ。その理由は,GPUで映像を普通に描いたうえで,PS VRの接眼レンズに合わせた歪みを除去する映像処理を行うと,結果的に映像が縮小変形されてしまうので,解像度が不足した映像に見えてしまうのを避けるためであるという。

ただ,ゲーム中,常に約1.4倍の解像度による描画を継続できるわけではない。敵機や隕石などのオブジェクトや,爆発やビームなどのエフェクトが多いときは,フレームレートが60fpsを下回る可能性がある。そこで,高負荷時には,解像度のスケール値を約1.4倍から1倍まで,リアルタイムに下げる機構を備えているというのだ。

会場で披露されたデモでは,最大解像度時に「x1.399

2119×1191ドットという解像度は,ずいぶんと中途半端な数字に思えるだろうが,

|

|

デモの様子を撮影したムービーでは,4:09あたりから倍率と解像度が数値で表示されるので,映像と倍率の変化に注目してほしい。

セッションではもう1つ,「テンポラルアンチエイリアシング」(※テンポラルスーパーサンプリングとも呼ぶ)の有効性についても触れられていた。

Frostbiteエンジンは,グラフィックスエンジン部分に物理ベースレンダリングを採用しているのだが,この方式では,輝度の高い光源で照らされてできた1ドット以下の高輝度ハイライトがちらついて見える現象が発生しがちだ。

そうした問題は,X-wing VR Missionでも同様だったようで,過去フレームを参照してサンプリングとブレンドを行うテンポラルアンチエイリアシング処理を実装して,この問題を軽減したという。

ムービーの2:23あたりから,テンポラルアンチエイリアシングの効果を比較しているシーンがあるのでチェックしてみよう。

物理ベースレンダリングと時間方向のちらつきについては,シリコンスタジオがCEDEC 2014で行ったセッションレポートで詳しく説明しているので,詳細を知りたい人はそちらも参照してほしい。

UE4ベースの短編映像作品「The Human Race」がRTLの最優秀賞を獲得

本稿の最後に取り上げるのは,米国の自動車ブランドとして名高い「Che

本作は,Unreal Engine 4(以下,UE4)を使って作られているため,GDC 2017でEpic Gamesが行ったセッション(関連記事)の中でも紹介されたことがある。

デモの解説を担当したのは,The Human Raceを制作したイギリスの大手CGプロダクションであるThe MillのJoji Tsuruga氏だ(関連リンク)。わずか90秒という作品だが,Tsuruga氏が「短編映画」と称するだけのことはあり,見事にRTLの最優秀賞に当たる「Best Real-Time Graphics & Interactivity Award」を受賞していた。

|

|

舞台は,現代に極めて近い近未来。人工知能の「AXA」(アジャ)が運転するコンセプトカーと,人類最速のレーサーであるLouis(※架空の人物)が運転する現行世代のCamaroのどちらが速いかを競う峠レースを描いたものだ。登場する車は,Louisが運転するのが「2017 Camaro ZL1」で,AIのAXAが運転するのは,2015年の上海モーターショーで発表となった次世代電気自動車のコンセプトカー「Chevrolet FNR」である。

本作は,The Millのスタッフが編集ツールやレンダリング工程でUE4を使って制作したものだ。The Millが開発したゲームエンジンベースのリアルタイム映像制作フロー「Cyclops」の習作も兼ねていたそうだが,Epic Gamesも制作に全面協力していたそうだ。

Cyclopsとは「リアルタイムAR技術を応用した映像制作技術」であるとThe Millは説明しており,これを構築するにあたって,ゲームエンジンのUE4はなくてはならないものだったという。

Cyclopsの根幹を成す技術は,360度映像カメラで現実世界を撮影したうえで,その360度映像を全方位の環境マップとして扱い,カメラ位置に配置したCGキャラクタをに対して,イメージベースドライティング(IBL,全方位環境マップを全方位の光源と見なしてライティングする手法)でリアルタイム描画するというものだ。実写とCGの合成を,UE4ベースでリアルタイムに行うパイプラインと言い換えてもいいだろう。

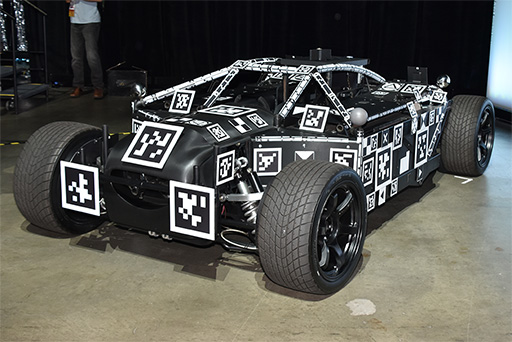

The Human Raceの制作にあたっては,カリフォルニア州の峠道でロケを敢行したそうだが,そこで実際に走らせた車が,The Millが独自に開発した「The Blackbird」である。

|

The Blackbirdは,車体のホイールベース(※前後輪間の長さ)やトレッド(※左右輪間の長さ)を自在に調整できる仕組みを備えた,シャシー剥き出しの自動車だ。ボディの上には,CG合成に使う位置情報検出用のARマーカーや,全方位環境マップを取得するためのカメラを装備しており,見た目は相当に異様である。

ロケ地で撮影した峠道の風景と,そこに映っているThe Blackbirdに対して,Camaro ZL1やFNRといったCGオブジェクトをリアルタイム合成した映像を,スタジオに戻ることなくロケ現場で確認できるのが,Cyclopsの特徴であるわけだ。

セッションでは,実際にThe Blackbirdをステージに持ち込んだうえで,さまざまな色をしたCamaro ZL1を合成する様子が披露された。ステージの情景をCGのボディに映り込ませていることを示すために,わざとレフ板をあてて照明状態に変化を付けてみせたり,まったく形状の違う1968年型のCamaroに変更してみせたりするだけに留まらず,自動車でも何でもない動物を重ねてみせる様子も披露して,来場者の笑いを誘っていた。

デモの様子を撮影したムービーを掲載しておくが,クラシックなCamaroに変わったときには,ちゃんとホイールとタイヤもまったく違うものに置き換わっているところを注意してみてほしい。Cyclopsではボディだけではなく,ホイールやタイヤにまでCGを被せることができるのだ。

リアルタイムデモであることを示すために,UE4のタイムラインエディタにThe Human Raceのプロジェクトファイルを読み込み,太陽の位置を変更したり,タイヤから出るスモークを増量したり,逆光時のレンズフレアを増やす様子までも実演してみせていた。映像本編もリアルタイムで編集でき,そのまま最終的な映像が完成する様子まで披露しており,映像制作にたずさわる来場者にとっては,なかなか刺激になったのではないだろうか。

2017年のRTLを制したのはThe Human Raceだったわけだが,振り返ってみると,

イベント閉幕後,ステージ上に持ち込まれたThe Blackbirdの周辺で,The MillのスタッフにEpic Gamesのスタッフも加わって記念撮影をしている姿が印象的であった。

|

- 関連タイトル:

Star Wars バトルフロント

Star Wars バトルフロント

- 関連タイトル:

Unreal Engine

Unreal Engine

- この記事のURL:

(C)2015 Lucasfilm Ltd. All rights reserved. Underlying technology and game design(C)EA. All rights reserved.

- Star Warsバトルフロント 【初回特典】:「Battle of Jakku」先行アクセスコード 同梱

- ビデオゲーム

- 発売日:2015/11/19

- 価格:¥3,300円(Amazon) / 3584円(Yahoo)