テストレポート

E3 2017でIntelが披露した「ワイヤレスVR」&「超高負荷VR」を体験してきた

|

ただ,そんなIntelブースで筆者は,同社の仮想現実(以下,VR)に関する最新の取り組みを体験する機会を得た。Intelが取り組む最新のVR環境について,じっくりレポートしてみたい。

WiGigでVR HMDをワイヤレス化するIntel

Intelが披露したVRに関する最新の取り組みとは,VRヘッドマウントディスプレイ(以下,HMD)「Vive」のメーカーであるHTCと共同で開発を進めているという,高速なワイヤレス通信技術を使ったVR HMDのワイヤレス化である。といっても,この分野に詳しくない人には,そのポイントが掴みにくいと思うので,まずは前提となるVR HMDの現状について説明しておこう。

|

そこで,現在一般的なVR HMDにおけるケーブル対策は2種類ある。

1つは,ホストPCをプレイヤーに背負わせてしまい,ケーブルを最短で済ませるというもの。いわゆる「バックパック型PC」というソリューションだ。

|

|

もう1つが,VR HMD側にホストPCの機能を組み込むというアイデアだ。現在一番多いのが,Androidスマートフォンをはめ込んで使う簡易VR HMDで,段ボール製の簡易ゴーグルを使うVR映像ビューワー的なものから,樹脂製のしっかりしたゴーグルとワイヤレスのモーションコントローラを組み合わせてゲーム用途にも使えるものまで,多種多様な製品がすでに存在する。

|

|

また,VR HMD自体にホストPC機能を内蔵するスタンドアロンタイプの製品もあり,Microsoftの「Windows Mixed Reality」(旧称:Windows Holographic)や,Googleの「Daydream」といったプラットフォームに対応するものが,年内にも各社から登場してくる予定だ。

こうした既存のケーブル対策に対して,第3の選択として研究開発が進められているのが,伝送路をワイヤレス化する手法,いわゆる「ワイヤレスVR」である。Intelが同社ブースで見せていたのは,その1つだ。

Intelが,ワイヤレスVR実現のために採用したのは,60GHz帯の電波を使う無線通信規格「WiGig」である。WiGigは,「IEEE 802.11ad」という規格をベースにしたもので,およそ10m程度の近距離に限られるが,7Gbpsという高速なデータ転送速度を実現できるのが特徴だ。将来的には,データ転送速度を24Gbpsまで拡大するロードマップも掲げられているという。

実際にブースで使われていたのは,PC用USBディスプレイ技術で知られるDisplayLinkが,WiGigを使ったVR向けソリューションとして発表した「DisplayLink XR」だ。ブース内の体験コーナーでは,DisplayLink XRの試作機とViveを用いたデモ環境を使い,実際にワイヤレスVRを体験できるようになっていた。

|

|

デモは,ヘッドバンド部分にワイヤレスアダプターを括り付けたViveを被って,シューティングゲームの「Space Pirate Trainer」(関連リンク)をプレイするというものだ。

|

|

|

なお,ワイヤレス伝送しているのは,ホストPCからVR HMDへ送る映像や音声だけでなく,VR HMDからホストPC側に送る位置や動きの情報のデータも含む。これにより,ホストPCとVR HMD間のデータ伝送は完全にワイヤレス化できているそうだ。

筆者も体験してみたが,有線時と比較しても遅延面での違いは感じられなかった。ただ,VR HMDに装着したワイヤレスアダプターが大きく,首を振るたびにカタカタと頭に当たるので,そっちのほうが気になってしまう。Intelの担当者は「これはあくまでプロトタイプだから。最終的にはごく小さいデバイスになる予定だよ」と強調していた。

|

|

Intel担当者によれば,この技術がどういう形で商品化されるのかは分からないということだったが,「この技術を最初に応用するのは,HTCで間違いない」ということだった。

低遅延高帯域重視のTPCastはWirelessHD1.1を採用

さて,VR HMDのワイヤレス化では,中国のTPCast Technologies(以下,

|

|

余談だが,ワイヤレス化した6基のViveを同じ場所で利用するための業務用バージョンもあり,5月には中国本土で販売を開始したという。中国国外向けは今夏発売予定とのことだが,日本で合法的に利用できるのかは分からなかった。

|

さて,TPCast Wireless Adapterは,ワイヤレス伝送にIntelと同じく60GHz帯の電波を使う機器だ。ただ,採用する規格はWiGigではなく,映像や音声の伝送に特化した「WirelessHD」をベースに,改良を加えた独自の技術であるという。

2008年に規格化された「WirelessHD1.0」は,データ転送速度が4Gbps程度しかなかった。しかし,2011年に策定された「WirelessHD1.1」では,WiGigの7Gbpsをしのぐ28Gbpsのデータ転送速度を実現し,VR HMDのワイヤレス化に使えるだけのスペックを備えている。

ちなみに,TPCast Wireless Adapterは,ホストPCからVR HMDへの映像と音声の伝送にWirelessHDを使うものの,VR HMDからホストPC側へのデータ伝送には,既存のWi-Fi技術を併用しているという。

筆者の取材によると,TPCast Wireless Adapterは,Lattice Semiconductorの第3世代WirelessHD送受信モジュール「MOD6300-T」「MOD6321-R」を使っているそうだ。また,映像データを伝送するときは,可逆圧縮技術を用いて伝送しているとのことだった。

MOD6300-TとMOD6321-Rは,伝送にともなう遅延が5ms未満であると謳っている。90fpsで計算すると,約0.45フレームの遅延だ。しかしTPCastでは,独自の最適化技術で遅延を2msにまで短縮したと主張している。これが事実なら,TPCast Wireless Adapterでの遅延は,90fps換算で約0.18フレームとなるわけで,Intelのソリューションよりも低遅延とは言えよう。

ワイヤレスVRに使う通信規格の違いと60GHz帯の限界

Intelがデモで披露したシステムと,TPCastのシステムは,どちらもともに60GHzの電波を使っている。この周波数帯の電波は「ミリ波」と呼ばれており,直進性が高く,振る舞いが光の特性に近いという特徴がある。その一方で,Wi-Fiで利用されている2.4GHz帯や5GHz帯の電波に比べると,遮蔽に弱い。

伝送距離は出力の大小に依存するが,直線距離でおよそ15m程度。周囲が壁に囲まれている部屋のような空間では,送受装置間に多少の遮蔽物があっても反射や回折によってデータ伝送は可能だが,壁越しの伝送は苦手で,実用的な通信距離は10m程度くらいという。

Intelブースの担当者も,「Viveが提唱している一辺が3m〜4mのルームスケールVRよりは広い空間での伝送は確実に可能である」と自信を見せていた。

ところで,同じ周波数帯の電波を使うとはいえ,一方はWiGig,もう一方はWirelessHDで,まったく別物で互換性は一切ない規格である。これらの規格についても,簡単に説明しておきたい。

|

現在でこそ,WiGigは,Wi-Fiの規格化を行う団体「Wi-Fi

しかし,今後登場してくる製品では,1つのモジュールで既存のWi-FiとWiGigの両方に対応する予定だという。Intelブースの担当者も「遠くない将来,現在のWi-Fiと同じ感覚で,マザーボードにWiGigのトランスミッターとレシーバーのモジュールが標準搭載されるようになるはずだ」と,将来の普及に自信を見せていた。

IntelはWi-Fiモジュールの大手でもあるので,とくにPCでWiGigとWi-Fi両対応の製品が増えてくるというのは,あり得ない話ではないだろう。

一方のWirelessHDは,現在はSilicon Imageの一部門であるSiBeamが,映像と音声の伝送用に開発した規格をベースとしたものだ。28Gbpsという高い通信速度と低い遅延というスペックは,WiGigに勝っている。

ただ,双方向通信が前提のWiGigとは異なり,ペアとなるトランスミッターとレシーバー間で一方向の通信しか行えないのが,WirelessHDの問題点だ。もともと「映像と音声の無線伝送を行うための技術」がスタート地点だったので無理もないが,VR HMDで使うには,Wi-FiやBluetoothといった他の通信手段と併用しなくてはならない点がネックとなるだろう。

話は変わるが,60GHz帯の電波を用いたワイヤレスVRの映像伝送では,低遅延の可逆圧縮技術を使うのが基本となるようだ。

既存のワイヤレス映像伝送技術,たとえばMiracastなどでは,H.264を用いたフレーム単位の圧縮(※フレームバイフレーム圧縮)技術を利用しているが,

ラインバイライン圧縮は,MPEGのような複数フレームの相関情報を応用した圧縮技術ではないため,圧縮率は大したことがない。しかし,対象映像を走査線ごとに圧縮伝送して,それを受信したそばからデコードしていけるので,MPEGよりも低遅延での伝送が可能という理屈である。

VR用途においては,映像伝送による遅延は極力短くしたいので,ラインバイライン圧縮のほうが適すると言えよう。

ただ,遅延よりも筆者が気になるのは,60GHz帯のデータ転送速度が,将来のVR HMDで実現するであろう映像のさらなる高解像度化に対応できるのかという点だ。

現在のWiGigで使える7Gbpsでは,ViveやRiftが採用する2160

28GbpsのWirelessHDや,24Gbpsに高速化するという将来のWiGigならば,4K解像度の3840×2160ドット(※片目あたり1920×2160ドット)の90fpsであれば,無圧縮でも伝送できそうだ。しかし,これ以上の高解像化には対応できまい。

ワイヤレスVRを支えるインフラとして,60GHz帯の電波を使うという方針は見えてきたが,これによって将来も安心かと問われると,安請け合いできないというのが現状だろう。

Core i9-7920Xを使った超高負荷なVR体験に驚く

ワイヤレスVRの話題はこれくらいにして,Intelブースのもう1つの目玉だった,

COMPUTEX TAIPEI 2017でIntelは,Core XシリーズのCPU計7製品を発表した

デモ用のPCは,Core i9-7920Xを使っている以外のスペックは非公開だったが,GPUには型番不明のNVIDIAのGeForce GTX 10シリーズを使っていることは,内部が見えたので確認できた。

|

|

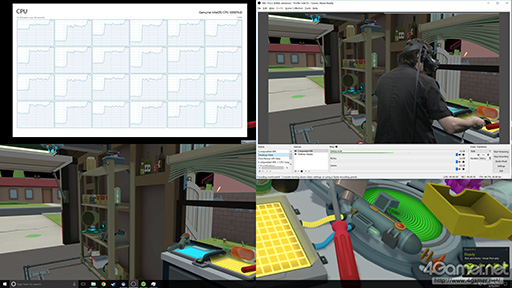

PCでVRゲームを動かすこと自体が,それなりに高負荷な処理だが,今回のデモが超高負荷である由縁は,VRゲームだけでなく,CGと実写の合成処理や,映像の配信といったアプリケーションを,同じPC上で同時に実行している点にある。

同時に動かしている処理の1つは,いわゆる「ソーシャルスクリーン」の生成だ。VRゲームの映像を観客に見せる場合,通常はプレイヤーの見ているVR映像を,普通のテレビでも見られるように複製しているだけだ。それに対して今回のデモシステムは,プレイヤーの視点とはまったく別の三人称視点でCG映像をレンダリングしたうえで,その映像に別途用意したカメラで撮影したプレイヤー自身の姿をリアルタイムで合成して,観戦用の映像を生成するという凝った仕組みとなっていた。

|

|

|

ゲームエンジン側は,プレイヤーが見ているVR映像とは別に,カメラの向きや位置に合わせた観戦用ゲーム映像をレンダリングする。そして,このカメラで撮影した「グリーンバック前でVRゲームをプレイするプレイヤー」の映像と,観戦用ゲーム映像をクロマキー合成して新たな映像を生成するのだ。そうすると,プレイヤーが本当にゲーム世界に入り込んだような合成映像を作れるというわけである。できあがった合成映像は,観戦用のディスプレイに表示されていたので,周囲の人も一緒に楽しめるのだ。

|

なお,VRゲームの映像はViveの表示解像度である2160×1200ドット解像度だが,カメラで撮影した映像や,カメラ視点のゲーム映像は3840×2160ドットの4K解像度とのこと。映像のクロマキー合成も4K解像度で行っており,しかもその合成処理は,ゲームの処理と並行してCPUで行っているという。

これだけでも相当に高い処理負荷となるはずだが,デモPCではもう1つ,負荷の高い処理を同時に行っている。それは,4K解像度の合成映像をH.264のソフトウェアエンコーダーでフルHD解像度に縮小してエンコードしたうえで,USBメモリに書き出すという処理だ。

しかも,このビデオエンコード処理は,GPU側のビデオエンコーダーはもとより,Intel製CPUのハードウェアビデオエンコーダ「Quick Sync Video」も使わず(※統合型グラフィックス機能を持たないCore i9シリーズは,Quick Sync Videoを備えていないようだ),CPUのみで実装したソフトウェアエンコーダーで行っているという。

|

ゲームそのものがシンプルという点は割り引く必要があるものの,これだけの処理負荷を同時にかけながら,プレイ中にもたつきなどは一切感じられなかったのだから,Core i9-7920X恐るべしといったところか。

一般のゲーマーが,1台のPCにここまで高負荷な処理をさせることはまずないだろうが,Core i9-7920Xの実力を知るための目安にはなりそうだ。現在,価格が明らかになっている最上位のCore i9シリーズは,10コア20スレッドの「Core i9-7900X」だが,今後は18コア36スレッドの「Core i9-7980XE」なんて製品も登場の予定である。ハイエンドPCに目がない人には,楽しみな新製品になりそうではないか。

- 関連タイトル:

Vive

Vive

- 関連タイトル:

Core X(Skylake-X,Kaby Lake-X,Cascade Lake-X)

Core X(Skylake-X,Kaby Lake-X,Cascade Lake-X) - この記事のURL: